Document Fintech

Document Fintech

Réponse détaillée le 20/8 de Laurent Dupoint, un des trois auteurs du rapport, à nos critiques

Je vous fais parvenir quelques éléments de réponse aux remarques pertinentes publiées sur votre site. À vrai dire je ne trouve pas votre article si négatif que cela : le point-clef est le flou conceptuel, or si je déplore votre état de "malaise" j'espère que ce trouble est guérissable. Par ailleurs je suis moi-même en tant qu'auteur du document de réflexion conscient des raccourcis sémantiques opérés (celui entre IA et ML y est détaillé, celui entre les différentes formes d'IA l'est moins, merci donc de l'avoir souligné.

Un réseau neuronal n'est certes pas un algorithme, en revanche c'est bien un algorithme qui construit le réseau de neurones. C'est plus généralement le schéma ontologique suivi dans ce document pour l'ensemble du Machine Learning : un algorithme instancie un modèle prédictif ou décisionnel (régression logistique, forêt aléatoire, réseau neuronal, etc.) et l'affine (model fitting en anglais) sur la base de données d'apprentissage. Nous focalisons la réflexion sur l'explicabilité du modèle, même si dans de futurs travaux nous étudierons aussi l'explicabilité de l'algorithme, ce qui est plus complexe (ainsi, expliquer comment sont sélectionnés les paramètres mais aussi les hyperparamètres du modèle).

Vous suggérez aussi que l'explicabilité est problématique uniquement dans le cas des réseaux de neurones. Or nous tentons de montrer que c'est un enjeu quel que soit le type d'IA mis en oeuvre : un ensemble d'arbres décisionnels peut être totalement opaque s'il contient plusieurs milliers d'arbres profonds, de même qu'une régression linéaire ayant de nombreux paramètres. Nous replaçons d'ailleurs l'enjeu d'explicabilité dans un cadre compatible avec le projet XAI du DARPA que vous citez : il s'agit bien de définir le niveau d'explicabilité d'un modèle prédictif déployé en finance, ainsi que d'encourager la mise en place d'interfaces explicatives pour présenter ces explications à l'utilisateur final (donc les "Explainable model" et "Explanation interface" de Matt Turek).

Enfin, les travaux de Seidel et al. que vous citez portent bien (voir leur titre) sur les systèmes autonomes. Or nous indiquons bien que l'état de l'IA en finance, du moins en France, n'en est qu'à ses prémices : il s'agit souvent de Machine Learning, très rarement de Deep Learning, en aucun cas de systèmes autonomes. Autrement dit, nous nous sommes penchés sur l'apprentissage automatique d'un modèle défini par un concepteur, un peu mois sur la boucle de rétroaction par laquelle les concepteurs font évoluer leur "modèle mental" en fonction des résultats produits par le modèle (car le secteur financier manque de maturité et de recul pour capitaliser sur cette rétroaction), et pas du tout sur l'apprentissage au fil de l'eau d'un système d'IA autonome, qui existera peut-être dans le secteur financier en France dans un avenir lointain - mais ce n'est pas pour demain et les data scientists et développeurs logiciels ont de beaux jours devant eux !

Encore merci pour votre retour et votre regard critique, et bien à vous.

Un grand merci de ces précisions, qui font d’ailleurs

progresser nos propres idées sur l’IA.

Nous

faisons suivre immédiatement à nos lecteurs, en espérant qu’ils

vous feront parvenir d’autres commentaires avant le 4 septembre.

Complément le 12/8. Laurent Dupont, un des trois auteurs du rapport, nous répond :

Bonjour Pierre, merci pour votre message. Je vous répondrai plus longuement sur le fond, mais je voulais dans l'immédiat vous indiquer où peuvent être adressées les réponses à la consultation : fintech-innovation@acpr.banque-france.fr

En effet je déplore que cet email ne soit pas indiqué dans le rapport complet : elle l'est seulement dans le questionnaire lui-même (https://acpr.banque-france.fr/sites/default/files/media/2020/07/09/20200611_questionnaire_gouvernance_evaluation_ia.pdf),

qui est disponible sur la même page du site ACPR (https://acpr.banque-france.fr/gouvernance-des-algorithmes-dintelligence-artificielle-dans-le-secteur-financier-0).

L’adresse email correcte est fintech-innovation@acpr.banque-france.fr

- - - - - - - -

La gouvernance de l’IA est peu souvent évoquée, et l’annonce du document de réflexion de l’ACPR n’a pas fait la Une des journaux. Mais merci aux Echos de l’avoir signalé (22/7).

Pourtant, il s’agit bien d’un thème central. Au delà du IA-hype comme du IA-bashing (pardon pour ce petit jeu frenchie), il s’agit de gouverner !

Le document est assez long (83 pages) et nous laisse une première impression de malaise sur l’emploi des concepts. Peut-on parler par exemples des « algorithmes d’IA », alors que les réseaux neuronaux ne sont pas tout à fait des algorithmes. Le spécialiste Jean-Paul Haton distingue trois approches de l'IA : symbolique (c’est à dire logique), statistique et connexionniste (réseaux neuronaux).

Dans les deux premiers cas, les décisions sont explicables et/ou justifiables, soit en montrant le raisonnement, soit en montrant que « c’est l’habitude ». En revanche, dans le troisième cas, la machine ne peut expliquer pourquoi elle a pris une décision. Le cas typique est la victoire de Deepmind au jeu de Go, avec son coup surprenant et décisif. Il y a donc un véritable problème d’explication, auquel tente par exemple de répondre le projet américain XAI, Explainable AI). Nous ne voyons pas ce problème évoqué dans le rapport.

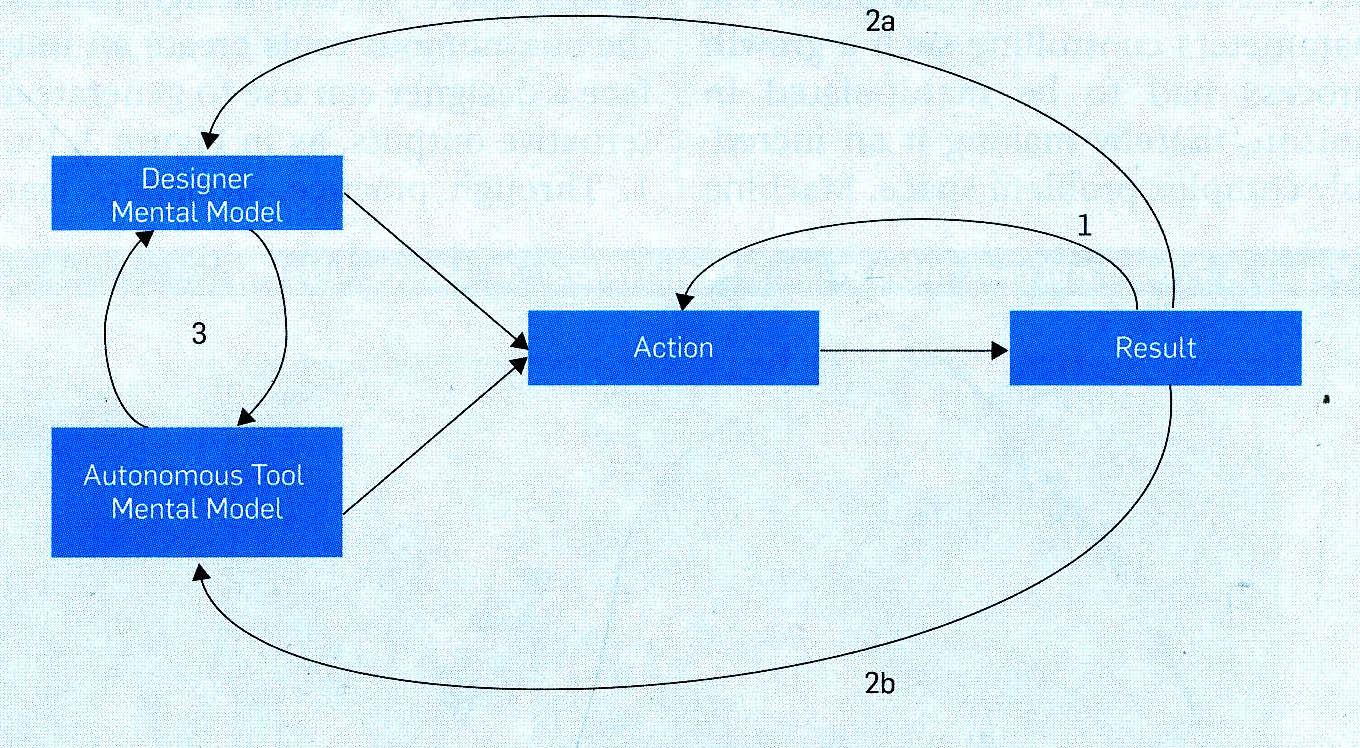

Par ailleurs, le rapport emploie largement le concept de « machine learning ». Il est essentiel aux réseaux neuronaux, mais pas aux autres modes de l’IA. En revanche, dans tous les cas de figure, les utilisateurs (ici la gouvernance) font naturellement évoluer le système en fonction des résultats obtenus et notamment des erreurs. Il y a un double processus de perfectionnement (learning), que Seidel et al. résument dans le schéma :

Plus sur la gouvernance Plus sur la gouvernance Plus sur l'IA Le post suivant Le post précedent L'index général

Il nous semble qu’une prise en compte de ces boucles multiples rendrait le rapport plus compréhensible et plus opérationnel.

Mais les auteurs

du rapport en savent sans doute plus que moi sur la question, et

d’ailleurs il s’agit d’un «document de réflexion »

soumis à consultation publique jusqu’au 4 septembre.

Malheureusement, le rapport ne dit pas comment envoyer ces réflexions

aux auteurs. Merci de nous l’indiquer si vous le trouvez avant nous

(Voir la réponse en début d’article).

En tous cas

le sujet est

d’importance, non seulement pour le monde financier, mais pour le

monde économique et a fortiori politique dans son ensemble. Nous ne

saurions donc trop vous encourager à y apporter vos contributions…

avant la date limite du 4 septembre.

Vos commentaires

seront appréciés, adressez les à pmberger (at) orange.fr.

A

cette même adresse, dites nous si vous souhaitez recevoir (ou pas)

les nouveaux articles de ce blog.